بهترین GPU برای یادگیری عمیق(بخش اول)

بهترین GPU برای یادگیری عمیق

اصولا به نتیجه رسیدن مرحله آموزش یادگیری عمیق طولانی است. این نه تنها یک فرآیند زمان بر است، بلکه یک فرآیند گران است. ارزشمندترین بخش مسیر یادگیری عمیق عنصر انسانی است. دانشمندان علم داده اغلب ساعت ها یا روزها منتظر می مانند تا آموزش کامل شود، که به بهره وری آنها و زمان عرضه مدل های جدید آسیب می رساند. برای کاهش چشمگیر زمان آموزش، می توانید از GPU های یادگیری عمیق استفاده کنید، که به شما امکان می دهد عملیات محاسبه AI را به صورت موازی انجام دهید. هنگام ارزیابی GPUها، باید توانایی اتصال چند GPU، نرم افزار پشتیبانی کننده موجود، مجوز، موازی سازی داده ها ، استفاده از حافظه GPU و عملکرد را در نظر بگیرید.

چرا GPU ها در یادگیری عمیق مهم هستند؟

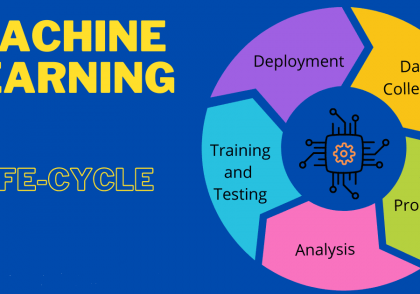

طولانی ترین و فشرده ترین مرحله در بیشتر پیاده سازی های یادگیری عمیق، مرحله آموزش است. این مرحله را می توان در مدت زمان معقولی برای مدل هایی با تعداد پارامترهای کمتر انجام داد، اما با افزایش تعداد، زمان آموزش شما نیز طولانی می شود. در نتیجه منابع شما مدت زمان بیشتری اشغال شده و تیم شما منتظر می ماند و وقت ارزشمندی را از دست می دهید. واحدهای پردازش گرافیکی (GPU) می توانند این هزینه ها را کاهش دهند و به شما این امکان را می دهند که مدلهایی با تعداد زیادی پارامتر را به سرعت و به طور کارآمد اجرا کنید. این به این دلیل است که پردازنده های گرافیکی به شما این امکان را می دهند که کارهای آموزشی خود را موازی انجام دهید، وظایف را بر روی خوشه پردازنده ها تقسیم کرده و عملیات محاسبه را به طور همزمان انجام دهید.GPU ها نیز برای انجام وظایف هدف بهینه شده اند و محاسبات را سریعتر از سخت افزارهای غیر تخصصی به پایان می رسانند. این پردازنده ها به شما این امکان را می دهند که همان وظایف را سریعتر پردازش کنید و CPU های خود را برای کارهای دیگر آزاد کنید. این امر تنگناهای ایجاد شده توسط محدودیت های محاسباتی را از بین می برد.

چگونه بهترین GPU را برای یادگیری عمیق انتخاب کنیم؟

انتخاب GPU ها برای پیاده سازی شما دارای بودجه و عملکرد قابل توجهی است. شما باید GPU هایی را انتخاب کنید که بتوانند پروژه شما را در دراز مدت پشتیبانی کنند و قابلیت یکپارچه سازی و خوشه بندی را داشته باشند. برای پروژه های بزرگ ، شما باید GPU با سطح تولید بالا و یا مجموعه GPU به عنوان مرکز داده ها را بکار ببرید.

ویژگیهایی از GPU که باید مد نظر قرار گیرد

این ویژگیها بر مقیاس پذیری و سهولت استفاده از GPU های انتخابی شما تأثیر می گذارد.

-

قابلیت اتصال GPU ها

هنگام انتخاب GPU، باید توجه داشته باشید که کدام واحدها می توانند به هم متصل شوند. اتصال GPUها مستقیماً به مقیاس پذیری پیاده سازی شما و توانایی استفاده از چند GPU و استراتژی های آموزشی توزیع شده بستگی دارد. به طور معمول، GPU های مصرف کننده از اتصال متقابل پشتیبانی نمی کنند (NVlink برای اتصال GPU درون سرور و Infiniband/RoCE برای اتصال GPU ها به سرورها) و NVIDIA اتصالات

GPUهای زیر RTX 2080 را حذف کرده است.

-

پشتیبانی از نرم افزار

GPUهای NVIDIA از نظر کتابخانه های یادگیری ماشین و ادغام با کتابخانه های رایج مانند PyTorch یا TensorFlow بهترین پشتیبانی را دارند. مجموعه ابزار NVIDIA CUDA شامل کتابخانه های شتاب دهنده GPU، کامپایلر C و C ++ و زمان اجرا و ابزارهای بهینه سازی و اشکال زدایی است. این به شما امکان می دهد بلافاصله بدون نگرانی در مورد ایجاد مجتمع های سفارشی شروع به کار کنید.

-

صدور مجوز

یکی دیگر از عواملی که باید مورد توجه قرار گیرد راهنمایی NVIDIA در مورد استفاده از تراشه های خاص در مراکز داده است. با به روزرسانی مجوز در سال 2018 ، ممکن است محدودیت هایی در استفاده از نرم افزار CUDA با GPU های مصرف کننده در مرکز داده وجود داشته باشد. این ممکن است سازمانها را مجبور به انتقال به تولید GPU های درجه بندی شده کند.

3 عامل الگوریتمی که بر استفاده از GPU تأثیر می گذارد

در تجربه ما در کمک به سازمانها برای بهینه سازی حجم کار یادگیری عمیق در مقیاس بزرگ، موارد زیر سه عامل اصلی هستند که هنگام گسترش الگوریتم خود در چندین GPU باید در نظر بگیرید.

-

موازی سازی داده ها

در نظر بگیرید که الگوریتم های شما برای پردازش، چه مقدار داده نیاز دارند. اگر مجموعه داده ها بزرگ باشد، روی GPUهایی که قادر به آموزش کارآمد چند GPU هستند، سرمایه گذاری کنید. برای مجموعه داده های مقیاس بزرگ، اطمینان حاصل کنید که سرورها می توانند بسیار سریع با یکدیگر و با اجزای ذخیره سازی ارتباط برقرار کنند. با استفاده از فناوری مانند Infiniband/RoCE، برای آموزش کارآمد و توزیع شده استفاده کنید.

-

استفاده از حافظه

آیا قصد دارید با ورودی های داده بزرگ برای مدل کار کنید؟ به عنوان مثال ، مدل هایی که تصاویر پزشکی یا فیلم های طولانی را پردازش می کنند دارای مجموعه آموزشی بسیار بزرگی هستند. بنابراین شما می توانید روی GPUهایی با حافظه نسبتاً بزرگ سرمایه گذاری کنید. در مقابل، داده های جداول مانند ورودی های متن برای مدل های NLP معمولاً کوچک هستند و می توانید با حافظه GPU کمتری از پس آن برآیید.

-

عملکرد پردازنده گرافیکی

در نظر داشته باشید که آیا از GPU ها برای اشکال زدایی و توسعه استفاده می کنید. در این حالت شما نیازی به قوی ترین GPUها نخواهید داشت. برای تنظیم مدل ها در درازمدت، به GPU های قوی نیاز دارید تا زمان آموزش را تسریع کرده و از ساعت ها یا روزها انتظار برای اجرای مدل ها جلوگیری کنید.

استفاده از GPU های پرمصرف برای یادگیری عمیق

در حالی که GPU های پرمصرف برای پروژه های یادگیری عمیق در مقیاس بزرگ مناسب نیستند، این پردازنده ها می توانند نقطه ورود خوبی برای یادگیری عمیق باشند. GPUهای پرمصرف همچنین می توانند مکمل ارزان تری برای کارهای پیچیده تر مانند برنامه ریزی مدل یا آزمایش سطح پایین باشند. با این حال، با افزایش مقیاس، می توانید GPUهای سطح مرکز داده و سیستم های یادگیری عمیق پیشرفته مانند سری DGX NVIDIA را در نظر بگیرید (در بخشهای بعدی بیشتر بیاموزید).

به طور خاص، نشان داده شده است که Titan V عملکردی مشابه GPU های سطح مرکز داده مانند RNN های Word ارائه می دهد. علاوه بر این ، عملکرد آن برای CNNها فقط کمی پایین تر از گزینه های بالاتر است. Titan RTX و RTX 2080 Ti چندان عقب نیستند.

-

NVIDIA Titan V

Titan V یک پردازنده گرافیکی رایانه شخصی است که برای استفاده دانشمندان و محققان طراحی شده است. بر اساس فناوری ولتای NVIDIA طراحی شده است و شامل هسته های تنسور می باشد. Titan V در نسخه های استاندارد و CEO(سئو) عرضه می شود. نسخه استاندارد حافظه 12 گیگابایت، عملکرد 110 ترافلاپس، 4.5 مگابایت حافظه کش L2 و گذرگاه حافظه 3072 بیتی را ارائه می دهد. نسخه سئو 32 گیگابایت حافظه و 125 ترافلاپس عملکرد، 6 مگابایت حافظه کش و باس حافظه 4096 بیتی را ارائه می دهد. نسخه اخیر نیز از همان حافظه های 8-Hi HBM2 استفاده می کند که در واحدهای 32 گیگابایتی تسلا استفاده می شود.

-

NVIDIA Titan RTX

Titan RTX یک پردازنده گرافیکی رایانه ای مبتنی بر معماری GPU تورینگ NVIDIA است که برای کارهای خلاقانه و یادگیری ماشین طراحی شده است. این شامل فناوری های Tensor Core و RT Core برای ردیابی اشعه و شتابدهنده هوش مصنوعی است. هر Titan RTX 130 ترافلاپس ، 24 گیگابایت حافظه، 6 مگابایت حافظه کش ارائه می دهد. این به دلیل 72 هسته تورینگ RT و 576 هسته تنسور دقیق Turing است.

-

NVIDIA GeForce RTX 2080 Ti

GeForce RTX 2080 Ti یک پردازنده گرافیکی رایانه شخصی است که برای علاقه مندان طراحی شده است. این پردازنده بر اساس پردازنده گرافیکی TU102 طراحی شده است. هر GeForce RTX 2080 Ti 11 گیگابایت حافظه، یک گذرگاه حافظه 352 بیتی، 6 مگابایت حافظه کش و تقریبا 120 ترافلاپس عملکرد ارائه می دهد.

پایان بخش اول

1 دیدگاه

به گفتگوی ما بپیوندید و دیدگاه خود را با ما در میان بگذارید.